Să nu uităm că Inteligenţa Artificială (IA) este, aşa cum au fost toate ştiinţele, o fiică a filozofiei care, cum se mai întîmplă, s-a îndepărtat, nu mai vrea să citească, nu mai e interesată de ceea ce a învăţat acasă. Inteligenţa Artificială a început ca o aventură filozofică în anii ’50, cu un articol al lui Alan Turing, care rămîne drept textul originar, fundamental al IA, publicat în revista Mind, deci într-o revistă de filozofie. Bineînțeles că nu exista o revistă pentru ceea ce numim azi computer science. Mai mult, contribuţiile diverşilor filozofi, de exemplu John Searle, cu celebrul experiment mental al „Camerei chinezeşti”, au ajutat radical în reorientarea domeniului, după ceea ce în anii ’80 şi chiar început de ’90 s-a numit „iarna Inteligenţei Artificiale”, cînd domeniul n-a mai avansat foarte mult.

Cum apare Inteligenţa Artificială ca știință? E de așteptat să aibă fundamente matematice şi să modeleze statistic, are diverse metode şi tehnici, dar în genere acestea nu aparţin nici ştiinţelor naturii per se și nici ştiinţelor umane şi sociale, cu toate că uneori sînt împrumutate şi derivate de acolo. Este o ştiinţă care nu începe de la ipoteze și, de obicei, preferă să „intuiască”. Esenţa acestei „intuiţii” este uşor transcrisă în tot felul de formule matematice şi „intuiţia” este legată de cum ar reuşi, de exemplu, un algoritm să navigheze prin masa de date. Această ştiinţă produce adesea modele insondabile sau greu explicabile, însă aceste modele sînt capabile de rezultate revoluţionare. În fond, relaţia dintre ştiinţele moderne, aşa cum le avem de vreo trei secole încoace, devine o convergență din ce în ce mai mare în domeniul Inteligenţei Artificiale. Tocmai de aceea se vorbeşte despre un anume sfîrşit al ştiinţei sau o depăşire a ştiinţei moderne, pentru că nu mai avem acum mai multe științe, ci o singură știință care produce diverse modele pentru toate celelalte ştiinţe şi care, astfel, va lua „pîinea de la gura” omului de ştiinţă.

Ne dorim sau nu, ne place sau nu, această ştiinţă este esenţială astăzi. Consider că, în acest moment, IA se află într-un „stadiu alchimic”. Asta nu înseamnă că ar face alchimie aceşti cercetători, căci rezultatele lor sînt, de cele mai multe ori, corecte. Dar vă propun cîteva analogii cu alchimia care s-ar putea să arunce o lumină aparte asupra felului în care se dezvoltă acum Inteligenţa Artificială.

Încă din 1965, Hubert Dreyfus, un post-fenomenolog, maestru al înţelegerii lui Heidegger, a formulat o critică totală la adresa Inteligenţei Artificiale din epoca sa. A spus că cercetătorii de atunci se comportă ca nişte alchimişti pentru că, aşa cum alchimiştii voiau să transforme metal în aur, și ei încearcă să transforme tot felul de lucruri în cunoaştere, fără a se uita la ceea ce este mai important: cunoaşterea este mereu situată, contextualizată, se întîmplă aici şi acum, dar se întîmplă și istoric, nu plutește într-un vid. Astfel, Dreyfus spunea: „Simbolismul şi procesarea abstractă nu vor reda niciodată complexitatea conştiinţei umane şi mai ales a acestei situări specifice în lume a fiecăruia”. Misterul naturii nu poate fi capturat doar prin formule simbolice – asta observau și alchimiştii. Cu alte cuvinte, Inteligenţa Artificială s-a confruntat cu limitele înţelegerii mecanice a minţii. Normal, lucrurile s-au schimbat şi, mai recent, Inteligenţa Artificială evoluează semnificativ, dar rămîne o ştiinţă ermetică şi dificil de interpretat. Din acest motiv rămîne utilă analogia cu alchimia. Modelele de învăţare automată, precum cele folosite de cel mai bun prieten al copiilor noştri, ChatGPT, pentru că le scrie tema, sînt privite nu doar ca tehnologii inovatoare, ci ca noi forme de gnoză, unde datele şi algoritmii pot sau par a oferi o cunoaştere profundă şi adesea inaccesibilă chiar celor care le construiesc. Nu cred că alţi oameni de ştiinţă se confruntă cu această problemă cu care se confruntă designerii de IA.

Continui analogia şi mă gîndesc la conceptul transmutaţiei. Acum nu mai transmutăm în plan fizico-chimic, ci în plan informaţional, transformăm datele brute în cunoaştere utilă. Bineînţeles, asta presupune rezolvarea unor contradicţii, pentru că datele din lumea noastră, din lumea socială în genere sînt pline de contradicţii, așa cum este și spiritul din lumea interioară. Astfel, rămîne de rezolvat problema contradicţiei.

IA poate fi văzută ca o oglindă în diferenţă sau o oglindă care (de)dublează umanitatea, o alteritate non-umană care, prin procesele sale ermetice, începe să ne reflecte, dar ne şi definește. În loc să înveţe din fapte brute, multe modele din ceea ce numim machine learning îşi extrag cunoştinţele predominant din imagini. Aici avem iarăși o trimitere la alchimie, pentru că și atunci exista un „cult al imaginilor”, așa cum avem, astăzi, unul al bazelor de date cu imagini, care evocă aceste tradiţii ezoterice. Mai mult, pentru mulţi dintre designerii ei, IA nu este doar un produs, ci încercarea de a crea o „mare operă”, ceea ce ne trimite iarăși la o idee alchimică. Această mare operă ar fi algoritmul universal. Deocamdată, el nu se poate descoperi, şi părerea mea este că nu se va putea niciodată. [...]

O dată la două săptămîni mai apare cîte un „geniu pustiu” care spune că IA va lua poziţia Terminatorului şi că va urma apocalipsa. Pînă și asta ţine tot de o poveste legată de alchimie, anume de ideea unei distrugeri a lumii finale ca să o putem recrea. Încă o dată vedem cum se ascunde aventura gîndirii mitice în gîndirea ştiinţifică.

Totuşi, IA devine ştiinţa centrală. Ea se mută în „inima lumii”, ca să folosesc tot o expresie din alchimie. Așa cum alchimiștii căutau esenţele fundamentale ale naturii, designerii de IA explorează profunzimile din procesele cognitive şi, cu datele care rezultă de aici, construiesc sisteme care să reflecte şi, într-un fel deloc paradoxal, să redefinească mintea umană.

O proprietate centrală a acestor sisteme este abordarea contradicţiilor. De ce? Aceste sisteme nu au fost la şcoala lui Aristotel; ele sînt nişte sisteme care aruncă în joc și ca punct de plecare o statistică „pe steroizi”. Aceste sisteme nu lucrează cu ceea ce am numi o logică clasică și au mai degrabă un fel de logică non-monotonică, dialetheică.

Pînă unde putem continua, totuşi, analogia cu alchimia? Sistemele de astăzi sînt lipsite de transparenţă. Într-un fel, asta aminteşte de revelaţie şi ocultare. Foarte mulţi din acest domeniu nici nu doresc să ajungă într-o zonă de transparenţă, adesea din motive economice, comerciale – dacă modelul ar fi transparent şi inteligibil oricui, de ce nu l-am implementa fiecare la noi acasă, prin propriile computere sau cloud-uri? Sistemele de IA funcţionează ca nişte „cutii negre” – este o expresie standard în domeniu. Mecanismele interne sînt ascunse astfel încît utilizatorii şi dezvoltatorii deopotrivă nu mai ştiu ce se întîmplă. Modul în care IA, lipsită de intenționalitate, ajunge la concluzii, la rezultate sau extrage concluziile rămîne adesea inaccesibil şi insondabil minţilor noastre și chiar minților specialiştilor. Or, asta ne aduce aminte de Athanorul alchimic, care era un recipient misterios în care transmutările se petrec dincolo de privirea celui care este iniţiat sau lucrează în laborator.

O altă frică este legată de autonomia pe care s-ar putea să o dobîndească IA, care mai devreme sau mai tîrziu ar putea să dezvolte o conştiinţă, ceea ce este o exagerare specifică epocii noastre. Ei bine, și aici avem un alt mit alchimic, acela al „luminii iniţiale” din care s-a format lumea. În egală măsură, persistă această frică de apocalipsă: odată ce IA capătă conştiinţă, oare nu cumva ne va trage la răspundere?

Așadar, ne putem întreba legitim dacă nu cumva dezvoltatorii de IA sînt noii hermetici, din moment ce activităţile lor, într-un fel sau altul, sînt ascunse privirii publice și sînt, cît de cît, deschise în interiorul propriei comunităţi? În oglindă, procesele interne ale sistemelor sînt obscure, iar rezultatele sînt prezentate uneori ca fiind „esenţele lumii”. Încă o dată vedem aici spectrul ermetismului. Ni se spune că, dacă vrem să avem parte de IA trebuie să trecem pe la cursurile de data science, ceea ce este o inițiere fără de care nu poți avea acees; doar că, de cele mai multe ori, ne întrebăm: cum au fost produse datele şi cum au ajuns acolo? Paradigma în care se află astăzi IA, care presupune oceane de date şi o ştiinţă fără ipoteze (tari), reflectă în egală măsură nişte căutări intelectuale afine alchimiei. Ce încercau alchimiştii? Căutau o transcendenţă încercînd să depăşească limitele cunoaşterii ca să dezvăluie secretele Universului. Nu uităm că alchimia a fost o „ştiinţă” care a pus bazele chimiei prin două lucruri: printr-o obsesie pentru empiric şi printr-o încercare continuă de experiment. Asta vedem astăzi şi în dezvoltarea IA, numai că, exact ca-n cazul alchimiştilor, apar dificultăţi în „a falsifica” (K. Popper), a verifica și a dovedi că sînt adevărate sau nu teoriile avansate.

Problema verificabilităţii devine evidentă cînd ne gîndim că, de cele mai multe ori, modelele din machine learning obţin rezultate favorabile în setul de date specifice, dar performanţa lor poate varia semnificativ, în funcţie de contextul în care sînt aplicate. Dacă ne aducem aminte de ideile lui Karl Popper, din filozofia ştiinţei pe care a profesat-o, o teorie trebuie să fie falsificabilă pentru a fi considerată ştiinţifică. Însă, în cazul IA, multe dintre rezultatele obţinute sînt în esenţă ermetice, iar mecanismele interne ale algoritmilor rămîn adesea o cutie neagră pentru noi. De exemplu, ChatGPT, un model de generare în limbajul natural, poate produce răspunsuri coerente şi relevante în multe contexte, dar nu avem nici o metodă clară, universal acceptată, prin care să evaluăm validitatea sau acurateţea acestora în mod consistent, adică în fiecare caz. Această lipsă de reproductibilitate şi transparenţă reflectă frenezia experimentală, care a fost specifică şi lumii alchimiştilor.

Ne confruntăm cu dileme fundamentale legate de validitatea şi aplicabilitatea descoperirilor produse de IA. Frenezia de a experimenta continuu şi de a sta foarte aproape de empiric mă duce cu gîndul la o idee avansată în anii ’60 de Claude Lévi-Strauss, anume ideea „gîndirii sălbatice”. Antropologul francez susține că, de fapt, cei care nu au trecut printr-o tradiţie a raţionalismului, cum e cel occidental, nu sînt plasați sub nici o formă într-un plan inferior intelectual sau cognitiv, ei pur şi simplu au alte metode de a da semnificație lumii, care ţin de un fel de artă a bricolajului. Prin experiment şi bricolaj, omul aşa-zis „primitiv” – pentru că antropologul francez n-a vorbit despre populațiile primitive în sens peiorativ – reuşeşte să dea o imagine a lumii, şi este o imagine consistentă, coerentă, cu care se poate descurca. Ceva de genul acesta se întîmplă astăzi într-o zonă de cercetare a IA, numită „neuromorphic computing”, care imită structurile noastre cerebrale (acest lucru se întîmplă deopotrivă în hardware şi în software). Nu ştiu – din fericire sau din păcate – cei care construiesc astfel de structuri neuromorfice de ce funcţionează şi de ce există o dinamică specifică, de ce uneori rezultatele sînt impecabile, iar alteori dezastruoase. Drept urmare, se apucă să experimenteze, să mai schimbe ceva pe ici, pe colo, la fel cum se schimbă hiperparametri în deep learning, iar toată această căutare de „trial and error” („încercare și eroare”) ne aduce aminte, de fapt, de ceea ce antropologul francez numea „gîndire sălbatică”.

Prin urmare, de ce ar fi IA o ştiinţă fără teorie? Pentru că nu pleacă de la ipoteze, nu strînge date, nu caută să explice metoda, cu limitele ei, nu are standarde metodologice pe care celelalte ştiinţe, inclusiv cele idiografice (pe care le numim „umanioare” de cele mai multe ori), au fost forţate, în secolele al XIX-lea şi al XX-lea, să le dobîndească. IA nu atinge un astfel de standard.

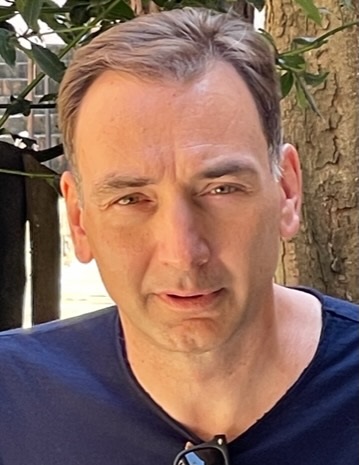

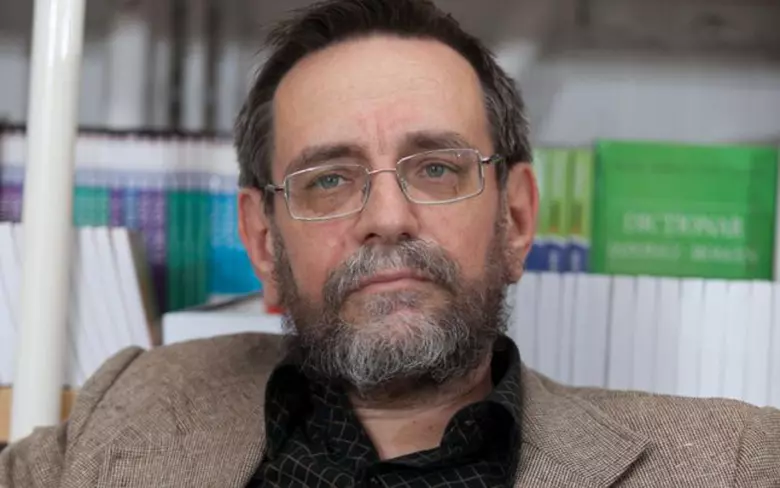

Constantin Vică este conferențiar la Facultatea de Filozofie și cercetător în cadrul Centrului de Cercetare în Etică Aplicată (CCEA), Universitatea București.

.jpg)

.jpg)

.jpg)