După o serie de mari promisiuni pe care piața începe să le vadă din ce în ce mai des ca fiind cel puțin exagerate, lumea Inteligenței Artificiale (IA) începe să cunoască, în anumite domenii, un mic recul. Cu toate acestea, există în continuare o aplicație a IA cu privire la care puține persoane se îndoiesc că nu va constitui, pe termen mediu și lung, o componentă integrantă a vieților noastre: rolul acesteia de consilier în diverse aspecte ale vieții noastre. Întreaga arhitectură a consilierii și a oferirii de sfaturi din epoca pre-algoritmică, fie că vorbim de viața noastră personală, fie că ne referim la cea profesională, cunoaște o veritabilă rearanjare. Apocalipsa roboților și a IA generală (AGI) a fost, dintotdeauna, o exagerare cu nuanțe hollywoodiene a adevăratei situații căreia trebuie să-i facem față: mașinării, roboți și algoritmi care ajung, cu un antrenament atent, să facă (cel puțin la fel de bine ca noi) diverse sarcini considerate habitual drept tipic umane. Iar printre aceste sarcini se numără, astăzi, unele pe care obișnuiau să le facă părinții, preoții, prietenii, profesorii, terapeuții sau consilierii financiari. Cu diverse grade de succes, apelăm la sfaturile unor chatboți precum ChatGPT, Claude sau Grok pentru a ne ajuta să desțelenim diverse situații dificile din viețile noastre, de la tema la geometrie sau cum ar trebui să-i răspundem partenerei sau partenerului nostru după o ceartă domestică la cel mai rentabil indice bursier în care ar trebui să investim în 2025. Cantitatea imensă de date cu care au fost antrenate, puterea lor de procesare, capacitatea lor de raționare și ușurința de a le folosi sînt cîteva dintre principalele atuuri ale acestor consilieri algoritmici.

Un Google Maps pentru moralitate?

Cîștigător al Premiului Nobel pentru economie în 2017, Richard Thaler obișnuia să sintetizeze principala contribuție a domeniului său, economia și psihologia comportamentală, cu o butadă de efect. De fiecare dată cînd vedem că cei din jurul nostru (sau chiar noi înșine) nu iau cele mai bune decizii, trebuie să fim conștienți de faptul că „oamenii nu sînt proști, viața este uneori prea dificilă”. Nu de puține ori, funcția și rostul tehnologiilor noi și emergente este tocmai să ne facă viața mai puțin dificilă pentru ca, în final, deciziile noastre să fie cele ale unor agenți înzestrați cu mai multă autonomie și libertate. Cazul paradigmatic este, poate, cel al Google Maps: ne permite să ajungem ușor la destinație indiferent dacă am mai parcurs vreodată acel drum și ne informează în timp real cu privire la ce se întîmplă în trafic. Dacă o IA ne poate oferi atît de multe sfaturi în domenii variate, nu ar putea oare să joace și rolul consilierului nostru moral? În loc să întrebăm un prieten sau pe profesoara noastră de etică din facultate, nu ar fi oare dezirabil să avem un echivalent pentru sfaturi morale al lui Google Maps pe telefoanele noastre inteligente?

Planul de a construi consilieri morali artificiali datează cu cîțiva ani buni înainte de revoluția marilor modele de limbaj (LLMs), cînd o sumedenie de filosofi și filosoafe, preocupați de problema îmbunătățirii morale, au trasat o întreagă agendă de cercetare. Există mai multe motive întemeiate pentru care un Google Maps pentru moralitate nu este deloc o idee atît de ciudată pe cît ar putea să pară la prima vedere. În primul rînd, sîntem niște ființe dominate de o inconsistență morală cronică și predispuși erorilor de tot felul din varii rațiuni psihologice (lista prejudecăților despre care ne vorbește psihologia morală este prea lungă pentru a fi citată aici). În plus, nici nu sîntem bine echipați pentru a fi niște ființe morale perfecte din mai multe motive: nu știm întotdeauna toate informațiile înainte să luăm o decizie, chiar dacă am avea acces la toate informațiile tot nu le-am putem procesa eficient și, dincolo de toate acestea, nu putem elimina influența pe care o joacă intuițiile și emoțiile morale în procesul evaluării etice. Dacă mai adăugăm la toate acestea predispoziția către akrasie (sau, mai simplu spus, slăbiciunea voinței), atunci peisajul imperfecțiunii noastre este complet.

Antrenat cu opere complete ale lui Aristotel, Kant și Mill, și fără neajunsurile noastre cognitive sau psihologice, un Google Maps pentru moralitate ar părea, la prima vedere, că ar fi într-o poziție privilegiată în raport cu prietenii, părinții sau alți depozitari ai sfaturilor la care apelăm uzual. Pare, așadar, că am rezolvat problema sfaturilor morale: așa cum spunea și Apple în 2009, „there’s an app for that!”. Ai o dilemă morală? La fel ca atunci cînd ești în Paris pentru prima oară și nu știi cum să ajungi de la aeroport la cazare, e de ajuns să deschizi aplicația, tastezi datele problemei, iar la sfîrșit ai niște indicii clare despre cum ar trebui să procedezi.

SocrateAI, nu Google Maps

Nu cred că povestea de mai devreme sună în vreun fel distopic, dar nici nu pare că ar fi, de fapt, vreo soluție perfectă la problema consilierii morale. Sigur că un chatbot poate să „știe” mai bine decît noi Kant, Mill sau Aristotel, dar povestea oferirii de sfaturi morale nu este rezolvată cu aplicarea algoritmică a unor principii derivate din marile teorii etice normative. În viața noastră de zi cu zi, apelăm la prieteni, părinți sau mentori pentru sfaturi morale tocmai pentru că, în virtutea experienței lor, aceste persoane au înțelepciunea practică dezvoltată pe parcursul timpului și cunoașterea locală fără de care orice consiliere de acest tip este sortită eșecului. În plus, un asemenea tip de externalizare a moralității vine la pachet cu niște riscuri pe care deja le observăm în jurul nostru. La fel cum utilizarea excesivă a Google Maps poate să ne reducă, de fapt, autonomia (cîți oameni mai sînt astăzi capabili să se orienteze după o hartă veche, de pildă?), simulacrul de deliberare morală al unui chatbot ne-ar priva de posibilitatea de a crește ca ființe morale pentru că, încet, dar sigur, nu vom mai fi noi cei care facem acest travaliu etic dificil, dar important. Funcția sfaturilor morale nu este doar locală, să ne rezolve o situație dată, ci și prospectivă: să devenim capabili, în timp, să rezolvăm noi înșine dileme noi cu care ne confruntăm.

Soluția, ne spun unii cercetători, nu vine din abandonarea completă a planului de a crea consilieri artificiali, ci de la o schimbare de optică: sigur, Socrate a fost îndeajuns de sîcîitor pentru vechii atenieni cît să fie condamnat la moarte de aceștia, dar totuși a descoperit ceva important. Să-i întrebi constant pe oameni de ce cred ceva este o unealtă utilă pentru a-i face să gîndească cu mintea lor. Un modul socratic instalat într-un consilier artificial care ne oferă sfaturi morale ar putea fi, pînă la proba contrarie, un companion algoritmic de nădejde în navigarea prin hățișul moralității. Bombardîndu-ne cu întrebări menite să ne îmbunătățească claritatea conceptuală, capacitatea de raționare morală ori să ne ajute să detectăm prejudecățile noastre psihologice, un Socrate în buzunarul fiecăruia ar fi radical diferit de un Google Maps al moralității: nu ne sfătuiește ce rută trebuie să urmăm din punctul A în punctul B, dar ne ajută să înțelegem de ce vrem să ajungem în punctul B, ori dacă punctul B chiar este un loc dezirabil.

Radu Uszkai este lector universitar în cadrul Departamentului de Filosofie și Științe Socioumane, ASE București și membru al Centrului de Cercetare în Etică Aplicată, Universitatea din București.

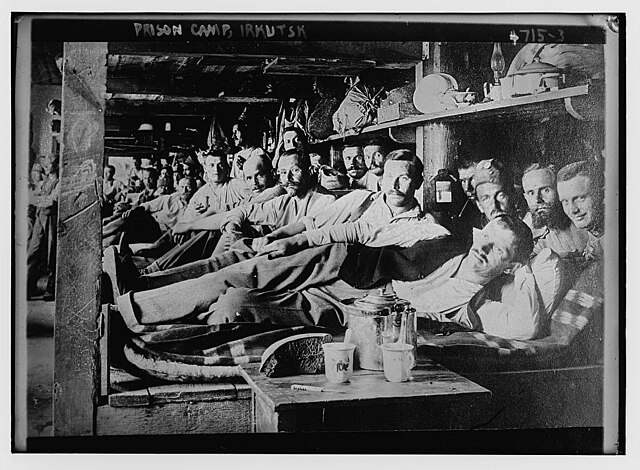

Credit foto: Wikimedia Commons

.jpg)

.jpg)

.jpg)